COLUMN

コラム

2026年05月01日

月10ドルで全部試せる時代。LLMコストが2030年に90%下がる前に、今すべきこと

タグ:LLM,コスト最適化,AI,Kubo

LLMコスト構造の大転換 — 2026年に起きている3つの変化

2026年、LLMコストを取り巻く環境が根本から変わりつつあります。

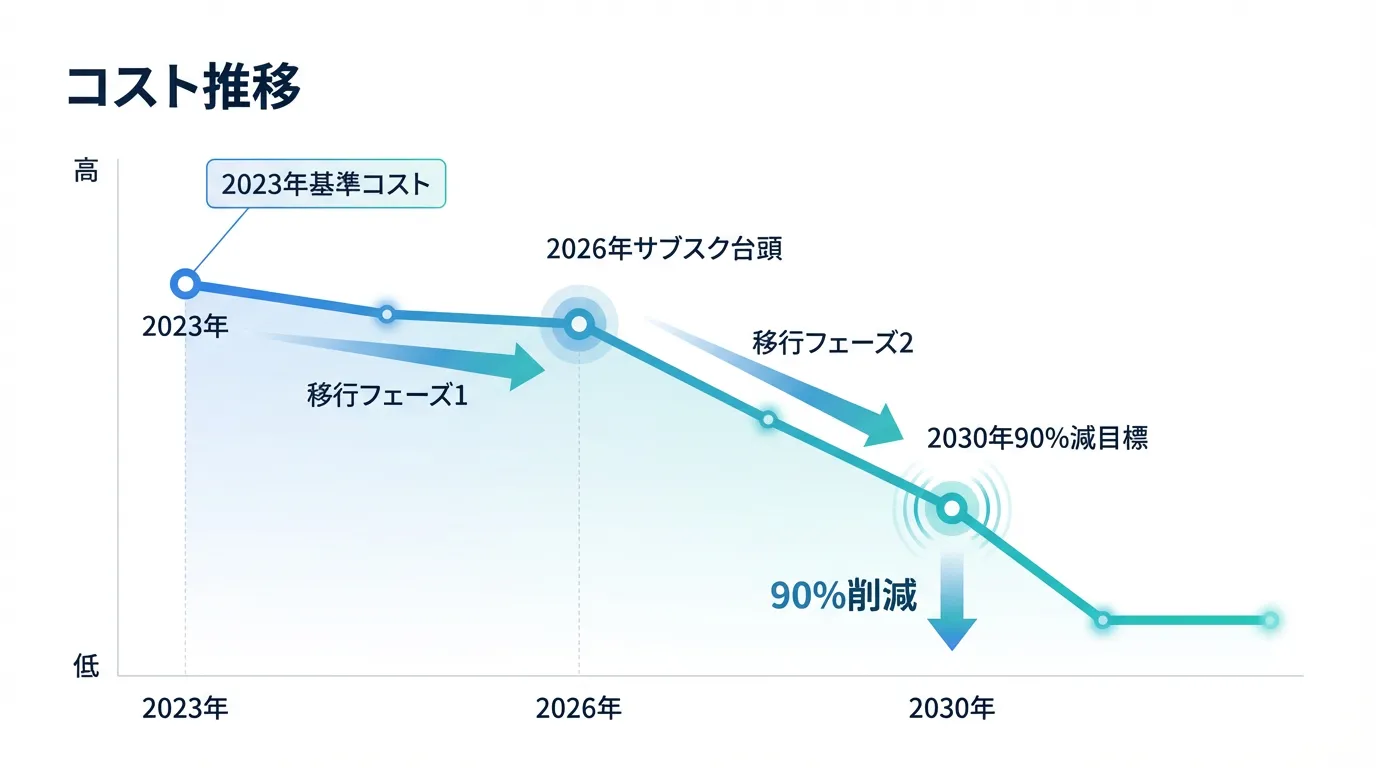

従来の「使った分だけ請求される従量課金」モデルから、「月額固定で使い放題」のサブスクリプションへ。そして、調査会社Gartnerによる衝撃的な予測があります。1兆パラメータLLMの推論コストは、2030年までに2025年比で90%以上下がるというのです。

これは単なる価格競争の結果ではありません。NVIDIA Blackwellアーキテクチャによる30倍の性能向上、セマンティックキャッシュによる冗長計算の排除、そしてローカルLLMの急速な性能向上が、LLM運用の経済学そのものを書き換えつつあるのです。

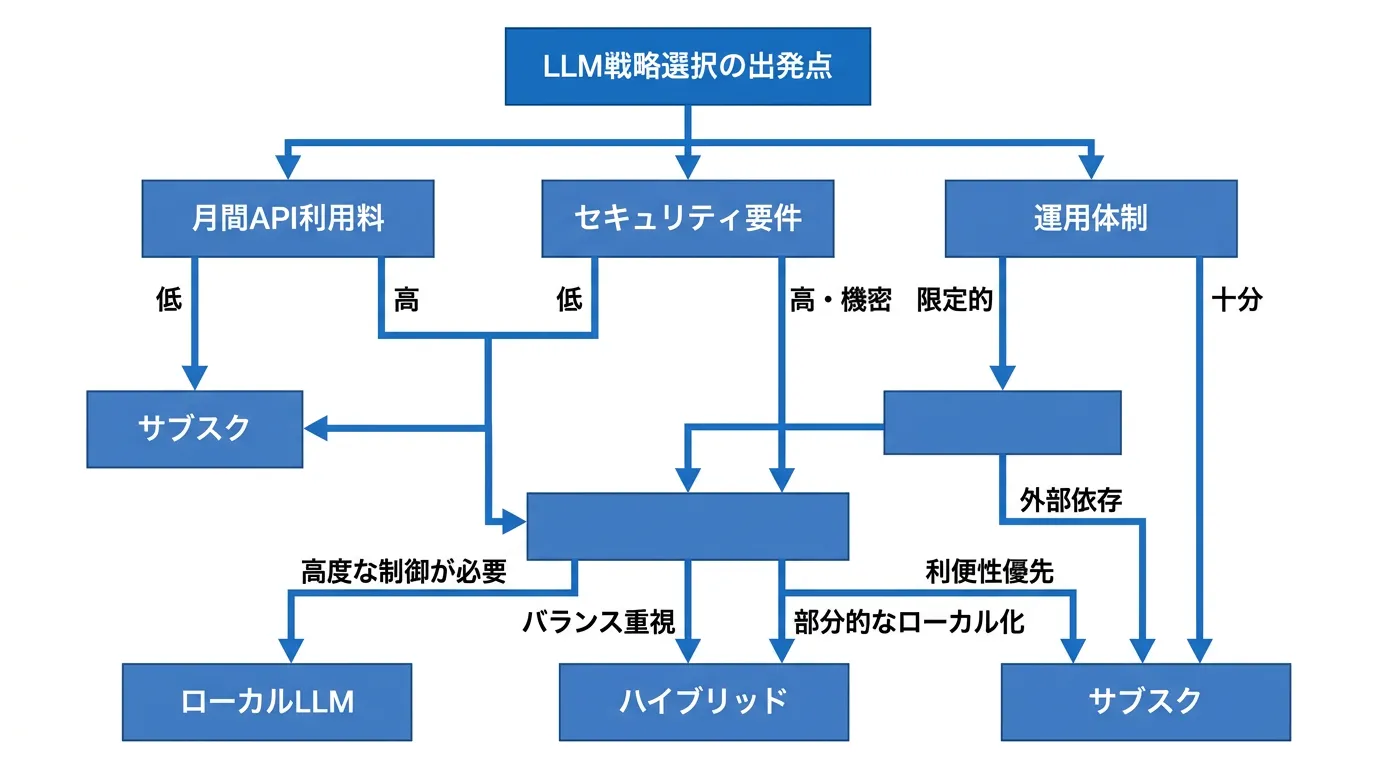

この大転換期に、DX推進担当や技術リードが直面している課題は共通しています。「どの選択肢を選ぶべきか」「今動くべきか、2030年まで待つべきか」「初期投資をどう経営層に説明するか」。本記事では、2026年の最新動向を踏まえ、LLMコスト最適化の3つの戦略を徹底比較します。

戦略1 — 月10ドルで全モデル試せる「サブスク時代」の衝撃

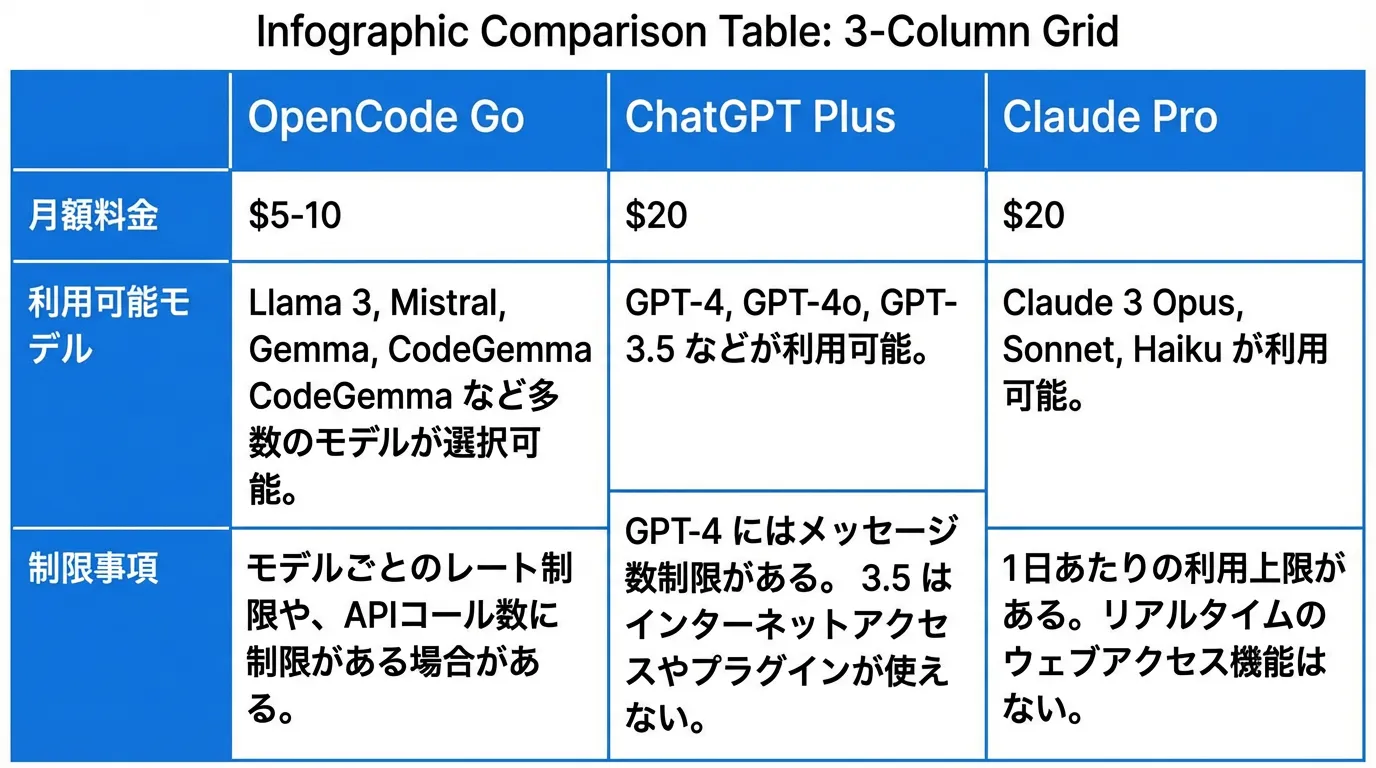

2026年4月、LLM業界に新しい選択肢が登場しました。OpenCode Goは、月5〜10ドルでKimi K2.6・GLM-5.1・DeepSeek V4・Qwen3.6・MiniMax等のオープン系トップモデルを横断利用できるサブスクリプションです。

従来、複数のLLMを試すには各プロバイダーのAPI料金を個別に支払う必要がありました。しかし今、主要LLMのAPIの料金比較を見ると、月額固定で複数モデルにアクセスできるプランが主流になりつつあります。

主要サブスクプランの比較

- OpenCode Go(月$5〜$10): Kimi K2.6を3倍枠で利用可能。AI駆動開発のメインドライバーとして十分な性能

- ChatGPT Plus(月$20): GPT-4へのアクセス、優先処理

- Claude Pro(月$20): Claude Opus/Haikuの優先利用

- Google One AI Premium(月$19.99): Gemini Ultra 1.0を含む

サブスクが適している組織

- 少人数チーム(3〜10名)で複数モデルを試したい

- 月間API利用料が$100以下で収まる規模

- PoC(実証実験)フェーズで柔軟にモデルを変更したい

- 予算管理を簡素化したい(毎月のコストが固定)

サブスクリプションモデルの最大のメリットは、毎月のコストが固定されるため予算管理が容易になることです。従量課金のようにAPI利用量の予測困難さに悩まされることがありません。

戦略2 — ローカルLLM導入でランニングコストゼロ化

クラウドLLMの従量課金に代わる選択肢として、ローカルLLMの導入が注目されています。

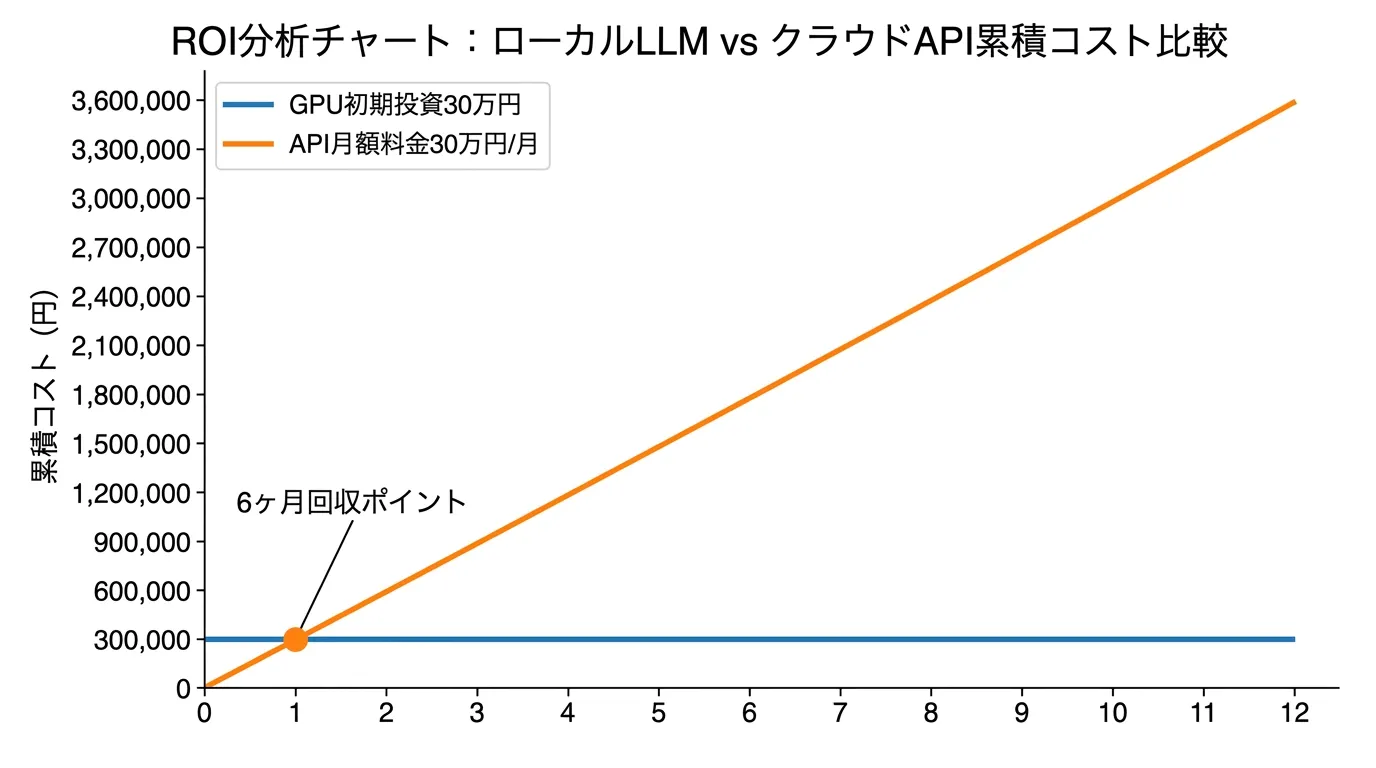

ローカルLLMは、一度環境を構築すればAPI利用料のような継続費用がかかりません(電気代・人件費を除く)。ローカルLLM導入のメリットを見ると、API利用料が月額数十万円を超えている場合、初期GPU投資(RTX 4090クラスで約30万円)は半年〜1年で回収可能とされています。

ローカルLLMを運用する基盤として、KuboのマネージドKubernetesが月額約48,000円から利用可能です。GPU付きK8sクラスタを迅速構築でき、運用負荷を最小化しながらローカルLLMを本番投入できます。

ローカルLLM導入の3つのメリット

- セキュリティ: データを社外に送信しない設計により、個人情報や機密データを安全に処理できます。ローカルLLMとは?開発・導入からPCスペックまで徹底解説によると、金融・医療業界での導入事例が増加中です。

- データ主権: 自社のニーズに完全に特化したカスタマイズが可能

- コスト予測性: クラウドプロバイダーのサブスク価格・API料金の予測困難さから解放

導入時の課題と対策

ローカルLLMを「一度導入すれば追加コストが一切かからない」と考えるのは正確ではありません。ローカルLLMとは?メリットやおすすめモデル、導入方法を解説によると、PCやGPUの準備、電力、保守、モデル更新、検証工数が必要です。

会社の組織単位で導入する場合、環境構築、モデルの選定、アップデート対応など、専門的な知識と運用工数が必要になります。Kuboのマネージドインフラなら、この運用負荷を大幅に削減できます。

戦略3 — ハイブリッド活用で最大90%削減の現実解

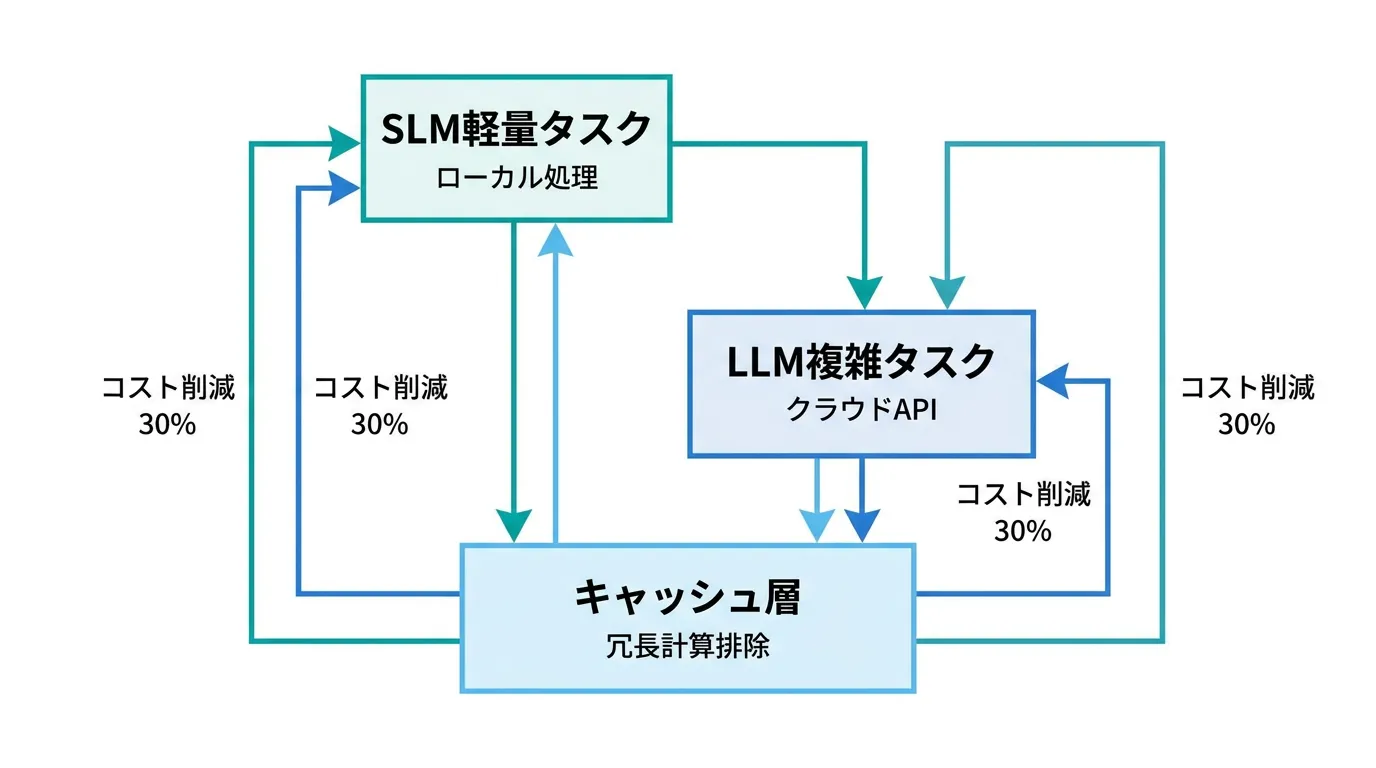

サブスクとローカルLLMの中間解として、ハイブリッド活用が実務での最適解になりつつあります。

ハイブリッド戦略の核心は、タスクの性質に応じてLLMを使い分けることです。軽量なタスクはローカルで処理し、複雑なタスクのみクラウドAPIに送る。これにより、AI API従量課金時代のコスト最適化戦略によると、50%ローカル化で約50%削減、90%ローカル化で約90%削減が期待できます。

3つの最適化テクニック

- SLM/LLM連携: Small Language Model(SLM)との併用により、単純なタスクは軽量モデルで処理し、LLMへの入力データを大幅に削減できます

- セマンティックキャッシュ: 同一・類似クエリの冗長計算を排除し、最大90%のコスト削減効果が実証されています

- モデルルーティング: タスクの難易度に応じて最適なモデルに振り分け。LLM APIコスト最適化は、導入時より運用フェーズで差がつきます

初期投資30万円は何ヶ月で回収できる?3つの戦略のROI試算

Gartner予測によると、LLM推論コストは2030年に90%以上下がるとされています。では、「2030年まで待つべきか、今動くべきか」。

結論から言えば、今動くべきです。理由は2つあります。

第一に、LLMコストは「今すぐゼロになる」わけではありません。2030年までの4年間、毎月数十万円のAPI料金を払い続けるのか、それとも初期投資30万円で今から削減を始めるのか。半年で回収できるなら、2030年までに7倍のリターンになる計算です。

第二に、AI活用の学習曲線があります。ローカルLLMの運用ノウハウ、ハイブリッド最適化のチューニング、これらは一朝一夕では身につきません。2030年にコストが下がっても、活用できなければ意味がない。今始めることで、2030年の競争で一歩先に出られるのです。

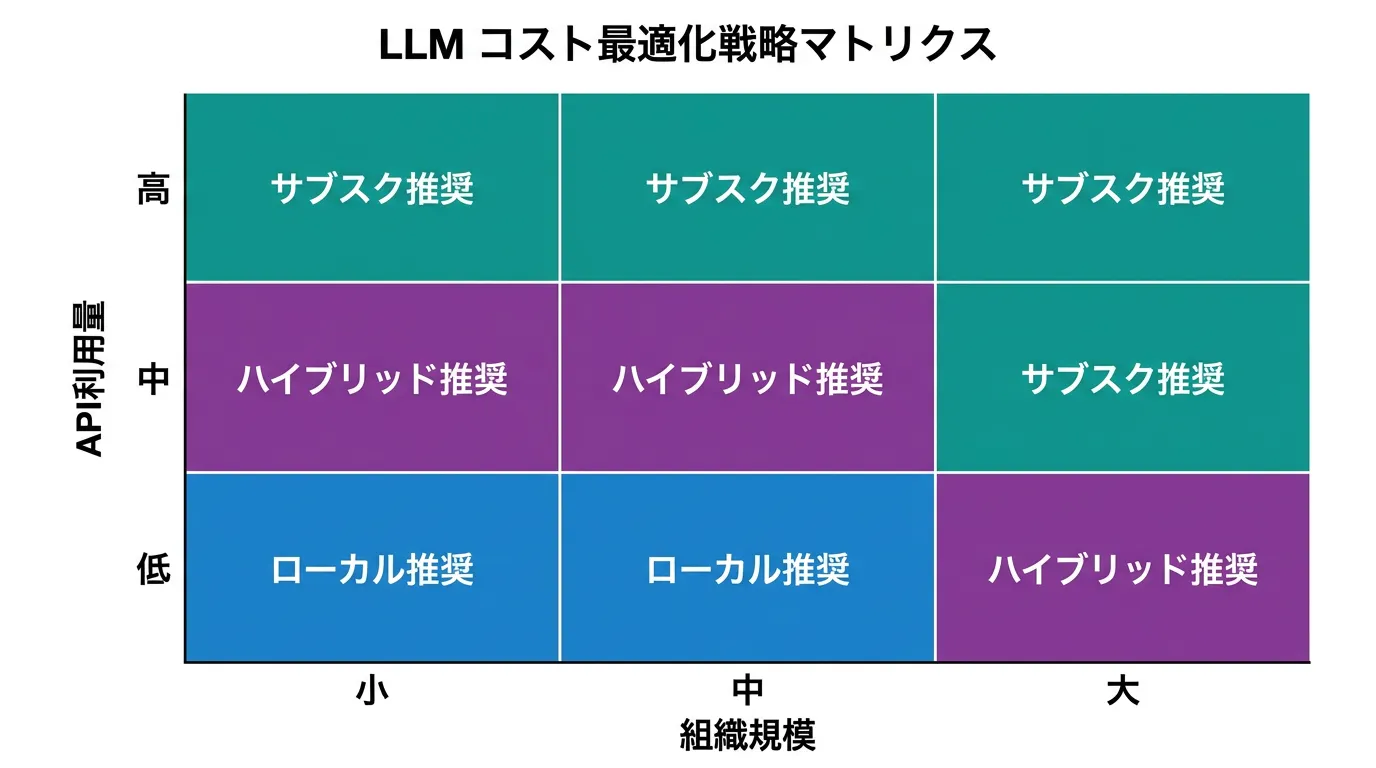

3つの戦略の使い分け基準

- サブスク(月$10〜$20): チーム3〜10名、月間API利用料$100以下、PoC・実験フェーズ

- ローカルLLM(初期30万円): 月間API利用料$500超、セキュリティ・データ主権重視、半年以上の継続利用

- ハイブリッド: 上記の中間。柔軟性とコスト削減を両立したい組織

LLMコスト最適化の戦略設計に迷ったら、まず無料相談で現状のAPI利用状況を分析することをお勧めします。また、AI駆動開発伴走セミナーでは、ローカルLLM構築の実践手法を学べます。

まとめ — LLMコスト最適化の3つの選択肢

2026年、LLMコストは「選ぶ」時代に入りました。従量課金だけでなく、サブスク、ローカルLLM、ハイブリッドという選択肢が揃った今、自社に最適な戦略を選べる環境が整っています。

月10ドルで複数モデルを試せる時代。2030年には推論コストが90%下がる未来。しかし、今動かなければ、2030年の競争で出遅れることを忘れてはいけません。

サブスクで気軽に始めるか、ローカルLLMでランニングコストをゼロにするか、ハイブリッドで柔軟性を保つか。いずれの選択も、あなたの組織のAI活用を次のステージへ押し上げる一歩となるはずです。

本格的なAI活用基盤の構築を検討される場合は、Hexabaseのソリューションもご検討ください。ローカルLLMからクラウドAPIまで、最適なAI基盤構築を支援します。

- カテゴリー

- タグ

- システム運用 (16)

- TypeScript (1)

- WebAssembly (2)

- ウォーターフォール開発 (2)

- 業務システム (28)

- CSS (2)

- GraphQL (1)

- プログラミング (31)

- スタートアップ (11)

- Nexaweb (1)

- BaaS (10)

- データベース (5)

- SPA (2)

- 基本用語 (26)

- Case study (5)

- Keyword (10)

- FaaS (1)

- システム開発 (69)

- スクラム (1)

- フロントエンド (38)

- AI (26)

- アジャイル開発 (18)

- Supabase (1)

- イノベーション (5)

- Database (2)

- 月額制 (1)

- PaaS (3)

- ACF (1)

- BookReview (3)

- サービス開発 (5)

- React (3)

- Firebase (1)

- クラウドサービス (12)

- low-code (2)

- バックエンド (8)

- ナレッジマネジメント (1)

- ChatGPT (1)

- Vue.js (2)

- Tailwind CSS (1)

- DBaas (2)

- プロジェクト管理 (13)

- セミナー (2)

- Web (21)

- 失敗事例 (2)

- Hexabase_health (1)

- 生成AI (7)

- 受託開発 (1)

- Kubernetes (3)

- WebComponents (1)

- 通知 (1)

- API (6)

- Next.js (1)

- フレームワーク (3)

- ローコード開発 (4)

- ノーコード開発 (1)

- JavaScript (2)

- Hexabase (12)

- LLM (3)

- 画像生成 (1)

- DX (34)