COLUMN

コラム

2026年03月16日

ChatGPTを「使う」から「使いこなす」へ。Transformer/GPTの仕組み理解がプロンプト精度を変える

タグ:Transformer,GPT,プロンプトエンジニアリング,AI駆動開発,AI Co-work

1. なぜ今、Transformerの仕組みを知るべきなのか

ChatGPT、Cursor、GitHub Copilot——AI開発ツールを日常的に使うエンジニアが急増しています。しかし、多くの現場でこんな声が聞かれるようになりました。「なぜこの出力が出るのか分からない」「プロンプトをどう改善すればいいのか分からない」。

AIツールの普及が進む一方で、それを「使いこなす」ためのスキルが問われる時代に入っています。

実際、2026年の開発現場では興味深いデータが報告されています。Findyの調査によると、ハイスキル層のエンジニアはAIツール導入後にプルリクエスト数が増加した一方、ジュニア層では減少が見られました。

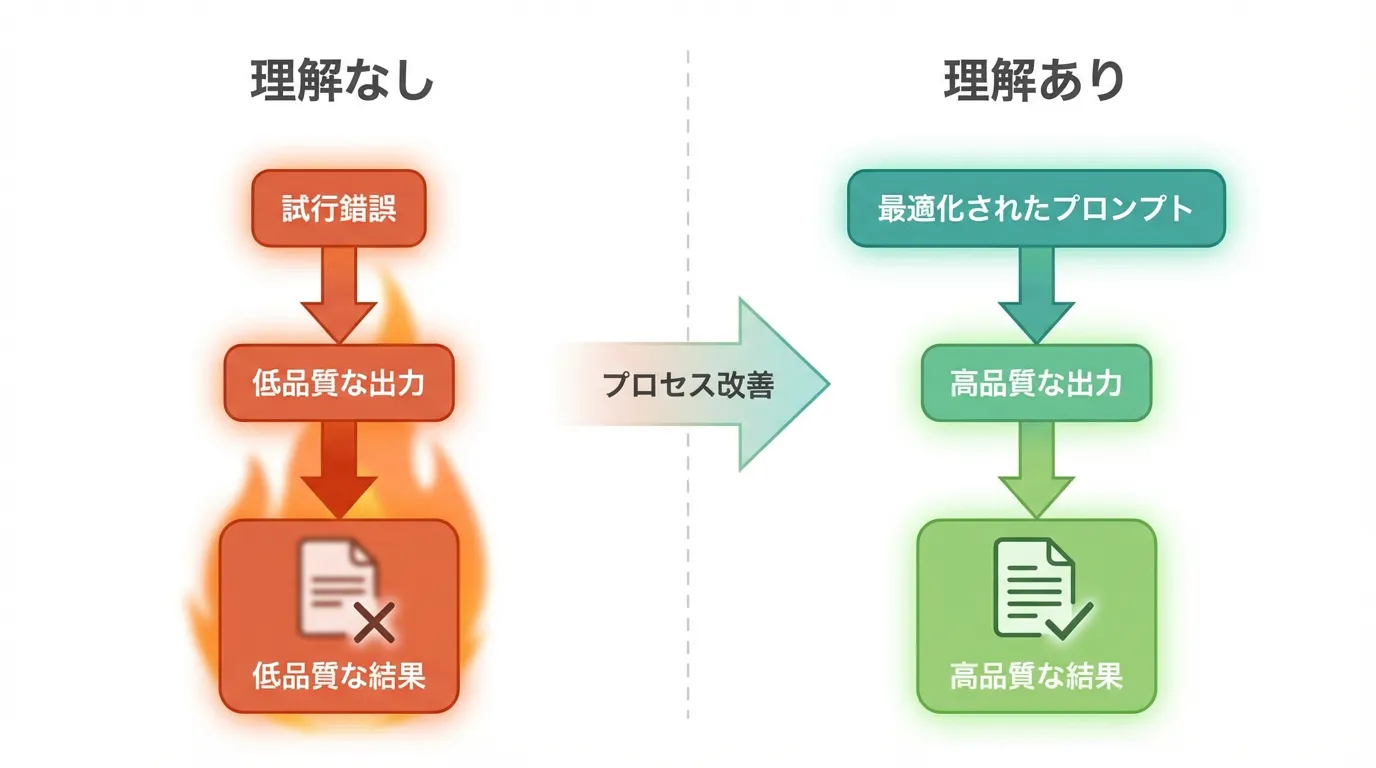

この二極化の背景にあるのが「AIをブラックボックスとして使うか、仕組みを理解して使うか」という違いです。

こうした流れの中で、AIと「協働」する発想が注目されています。Captain.AIのようなプラットフォームでは、AIエージェントを「チームの一員」として働かせることが可能です。

そのためには、今回解説するTransformerの仕組みを理解しておくことが、最高のスタート地点になるでしょう。

仕組み理解がもたらす3つの価値

- プロンプト精度の向上:内部動作を知ることで、意図した出力を得やすくなる

- ファインチューニング判断:どのケースでファインチューニングが有効かを技術的に判断できる

- API活用の最適化:温度パラメーター等の設定を用途に応じて使い分けられる

2. Transformerとは何か — AIブームの中心技術を60秒で理解

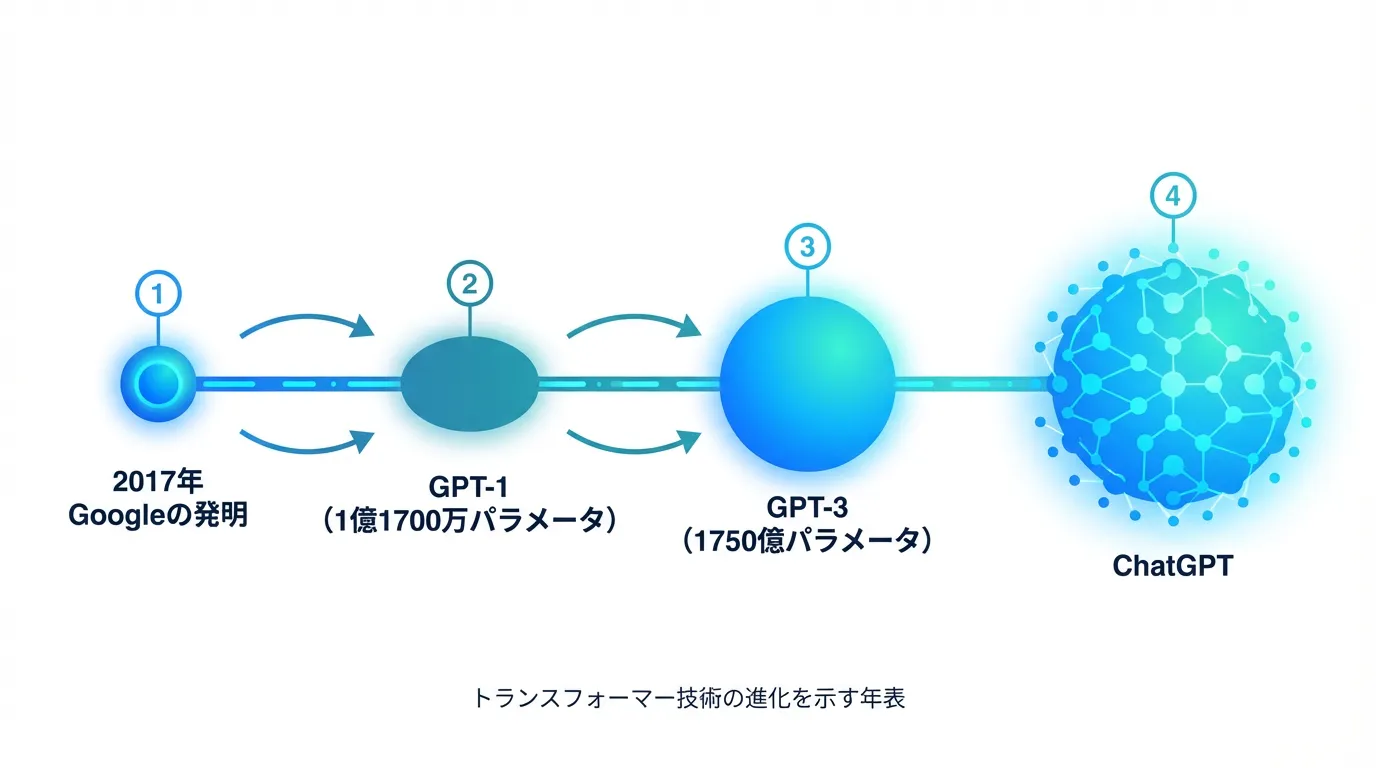

Transformerは、2017年にGoogleが翻訳タスクのために発明したニューラルネットワークの一種です。現在のAIブームを支える中心技術として、ChatGPT、BERT、画像生成AIなど、幅広いアプリケーションの基盤になっています。

GPT(Generative Pre-trained Transformer)は、このTransformerを「次の単語を予測する」タスクで訓練したモデルです。一見単純に見える「次の単語予測」を繰り返すだけで、長文のストーリーや技術解説、コードまで生成できるのがGPTの本質です。

従来技術との違い

- 並列処理が可能:従来のRNN(再帰型ニューラルネットワーク)は逐次処理だったが、Transformerは並列処理で高速化を実現

- スケーラビリティ:GPT-1(1.17億パラメータ)から GPT-3(1750億パラメータ)へと規模を拡大し、性能が飛躍的に向上

3. Transformerの心臓部 ① 単語埋め込み — 「意味」を数学で扱う仕組み

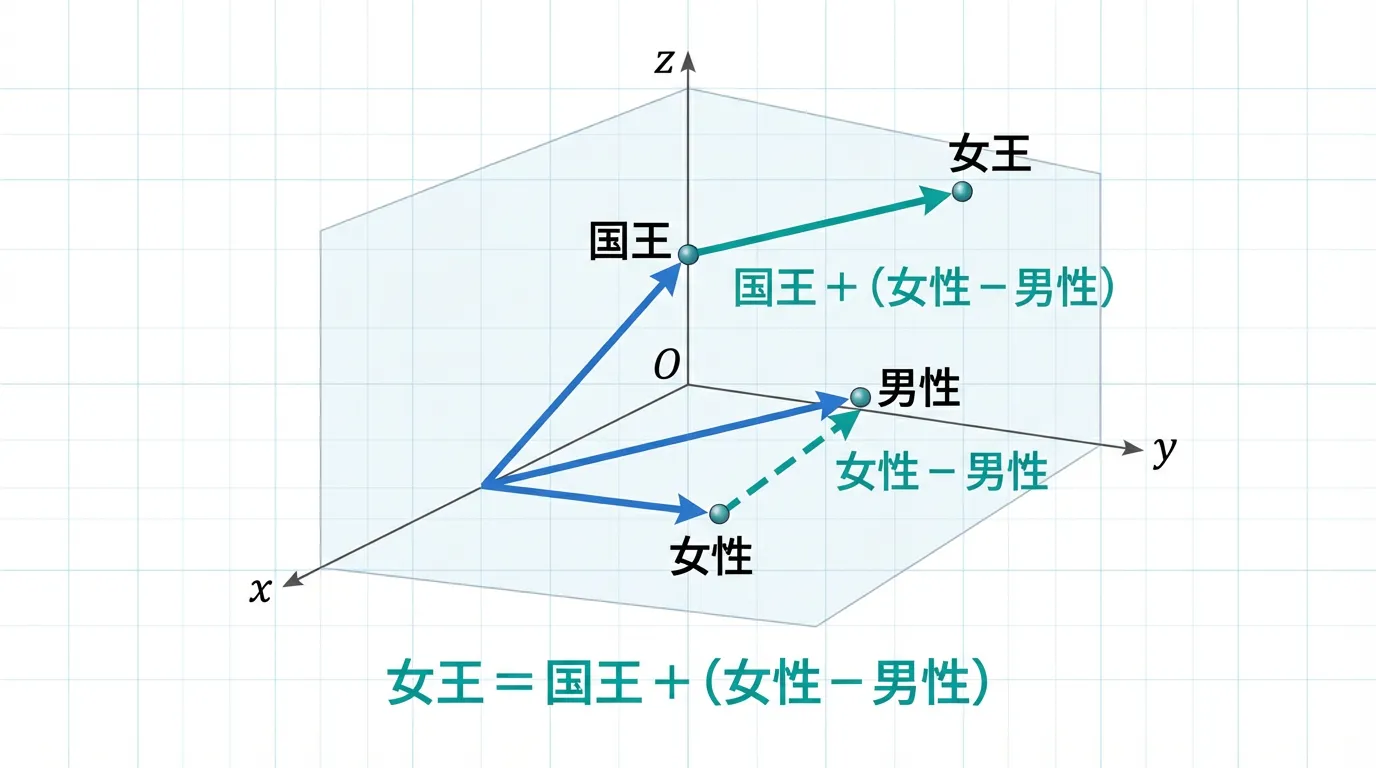

Transformerの最初のステップは「単語埋め込み(Embedding)」です。これは、単語を数値のリスト(ベクトル)に変換する処理です。

GPT-3では、各単語は12,288次元という高次元空間のベクトルとして表現されます。

この埋め込み空間では、似た意味の単語は近い位置に配置される傾向があります。さらに驚くべきことに、空間内の「方向」が意味を持ちます。

例えば、「女王 = 王 + (女性 - 男性)」という数学的な演算が可能です。つまり、「王」のベクトルに「女性 - 男性」という方向を加えると、「女王」に近いベクトルが得られるのです。

プロンプトエンジニアリングへの応用

この仕組みは、プロンプトで「○○の視点で」「△△の文脈で」と指定する際に内部で機能しています。埋め込み空間での方向操作により、AIは文脈に応じた出力を生成します。

仕組みを理解することで、プロンプトの「どの部分が出力にどう影響するか」が見えるようになり、試行錯誤の時間を大幅に削減できます。

4. Transformerの心臓部 ② アテンション機構 — 文脈を理解する鍵

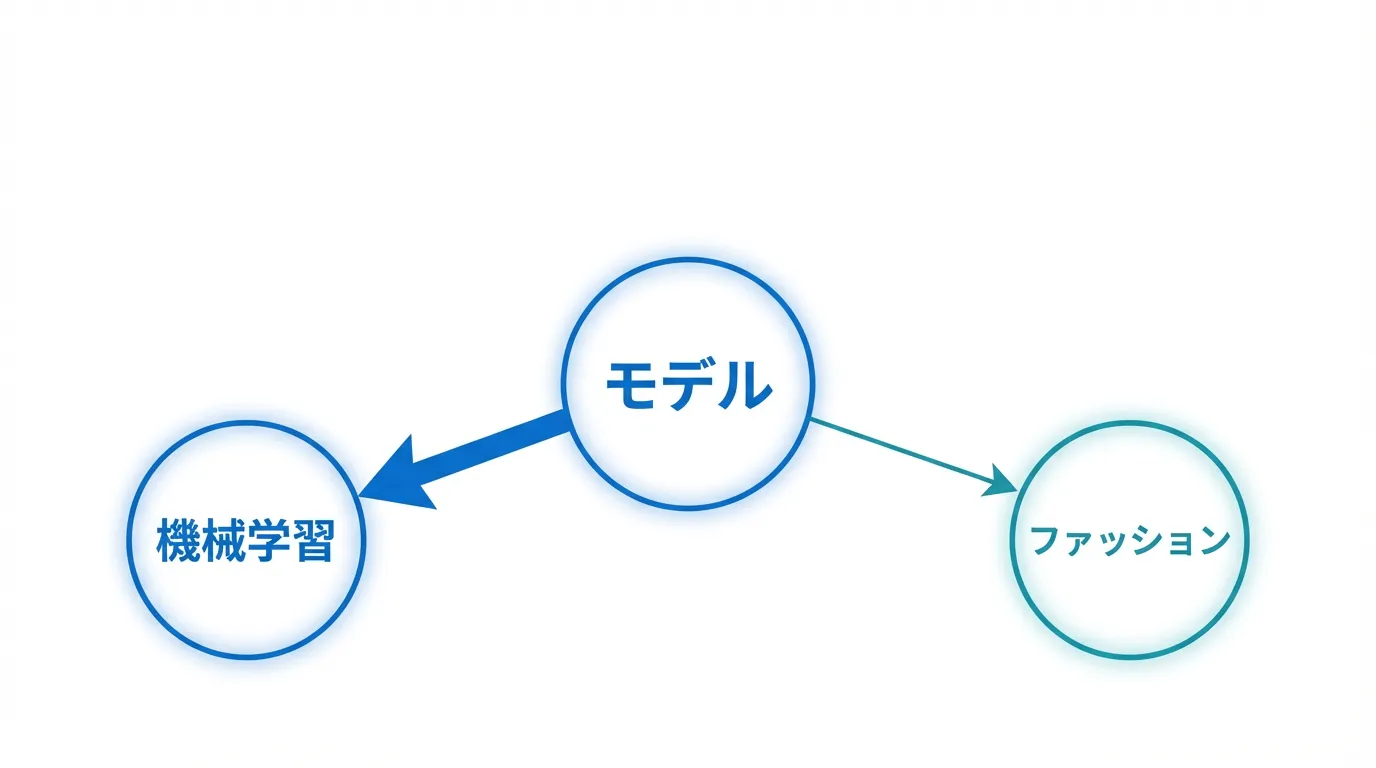

アテンション機構は、Transformerの「心臓部」と呼ばれる最も重要な仕組みです。その役割は、「文章内のどの単語が他のどの単語と関連しているか」を判定し、文脈に応じた意味を更新することです。

例えば、「モデル」という単語は、「機械学習モデル」と「ファッションモデル」では意味が全く異なります。アテンション機構は、周囲の単語(「機械学習」や「ファッション」)との関連性を計算し、文脈に応じた適切な意味を選択します。

Self-Attention(自己注意機構)

Transformerでは「Self-Attention」という仕組みが使われています。これは、文章内の全単語間の関係性を同時に考慮する方法です。

この並列処理により、長い文章でも効率的に文脈を把握できます。

プロンプトへの影響

長いプロンプトを書く際、重要な情報を前半に置くか後半に置くかで出力が変わることがあります。これはアテンション機構が文脈をどう処理するかに起因します。

仕組みを知ることで、Few-shot学習での例示の順序や配置を最適化し、出力品質を向上させることができます。

5. Transformerの心臓部 ③ 次の単語予測とソフトマックス — 確率分布から生成へ

GPTの最終ステップは、「次にどの単語が来るか」の確率分布を生成することです。Transformerの最後の層から、語彙に含まれる数万個のトークンそれぞれについて、「次に来る確率」が計算されます。

ソフトマックス関数の役割

ソフトマックス関数は、ネットワークの出力(ロジット)を確率分布に変換します。すべての値が0〜1の範囲に収まり、合計が1になるように正規化されます。

この確率分布から1つのトークンをサンプリングし、それを入力に追加して再度予測を実行——これを繰り返すことで長文が生成されます。

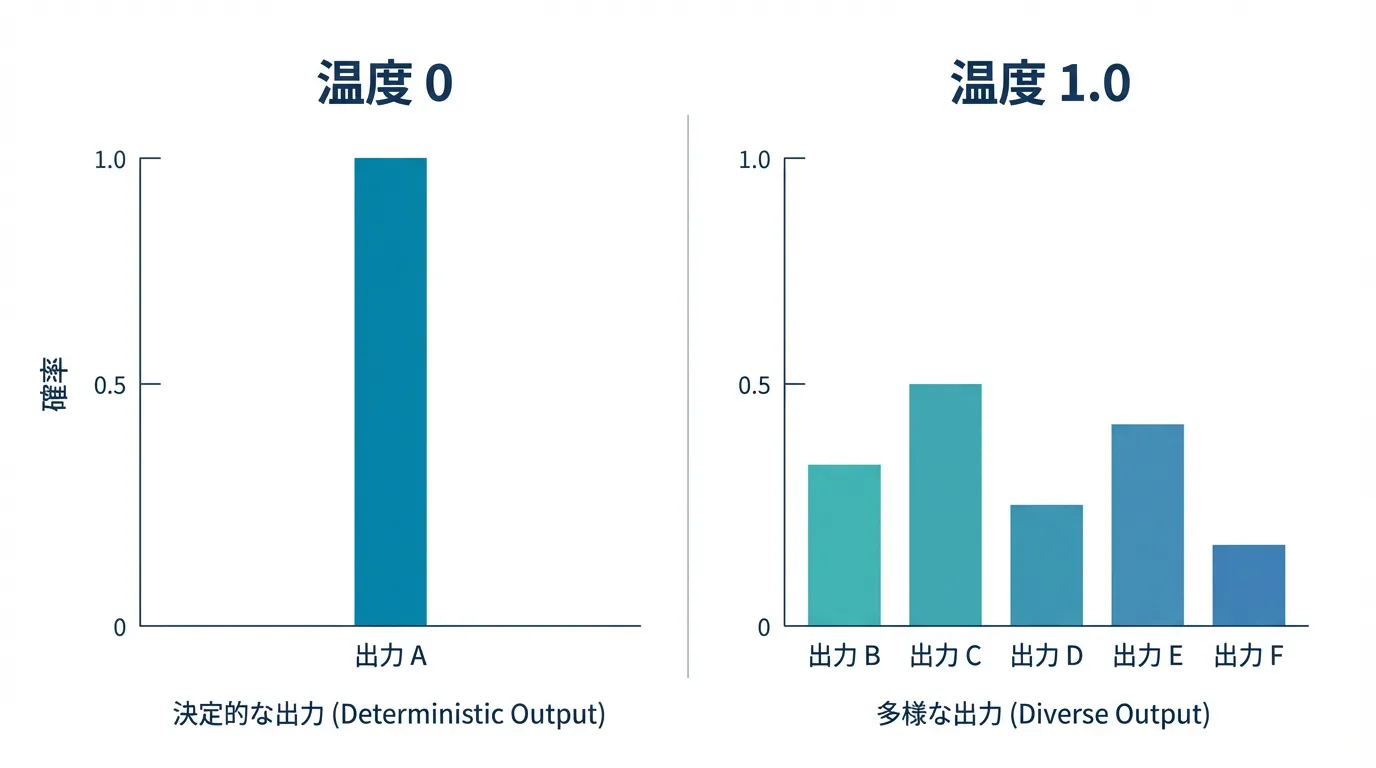

温度パラメーターで「創造性」を制御

温度パラメーター(Temperature)は、生成の「創造性」を制御する重要な設定です。

- 温度0:常に最も確率の高い単語を選ぶため、出力が確定的になる。コード生成など正確性が求められる場面に適する

- 高温度(1.0以上):低確率の単語も選ばれやすくなり、ランダム性が増す。アイデア発想やクリエイティブな文章生成に適する

ChatGPTのAPI設定で「Temperature」という項目を見たことがあるかもしれません。この仕組みを理解することで、用途に応じた最適な設定が可能になります。

6. 仕組み理解がプロンプトエンジニアリングを変える — 3つの実践例

ここまで解説したTransformerの仕組みは、実際のプロンプト作成にどう役立つのでしょうか。3つの実践例を紹介します。

例1: 文脈制御の精度向上

埋め込み空間の理解により、「○○の視点で」「△△の文脈で」という指示の効果を最大化できます。

プロンプトで「方向」を明示することで、意図した出力を得やすくなります。例えば「技術リード向けに説明して」という指示は、埋め込み空間で「技術リード」という方向を加える操作に相当します。

例2: 長文プロンプトの最適化

アテンション機構の理解により、重要な情報をどこに配置すべきか判断できます。

Few-shot学習での例示の順序や、コンテキストサイズ(GPT-3では2048トークン)の制約を意識したプロンプト設計が可能になります。

例3: 温度パラメーターの使い分け

用途に応じた温度設定の指針:

- コード生成:温度0.2(正確性重視)

- 技術文書:温度0.5(安定性と多様性のバランス)

- アイデア発想:温度0.8〜1.0(創造性重視)

こうした仕組みを理解してAIを使いこなすエンジニアと、ブラックボックスとして使うエンジニアでは、AI駆動開発での成果に大きな差が生まれます。

Captain.AIは、この「AI Co-work(AIとの協働)」の思想を実装したプラットフォームです。AIエージェントに「スキル」を教え、チームの一員として働かせる——Transformerの仕組みを理解することで、こうした次世代の開発スタイルをより効果的に実践できます。

7. AI駆動開発の現場で「仕組みを知るエンジニア」が強い理由

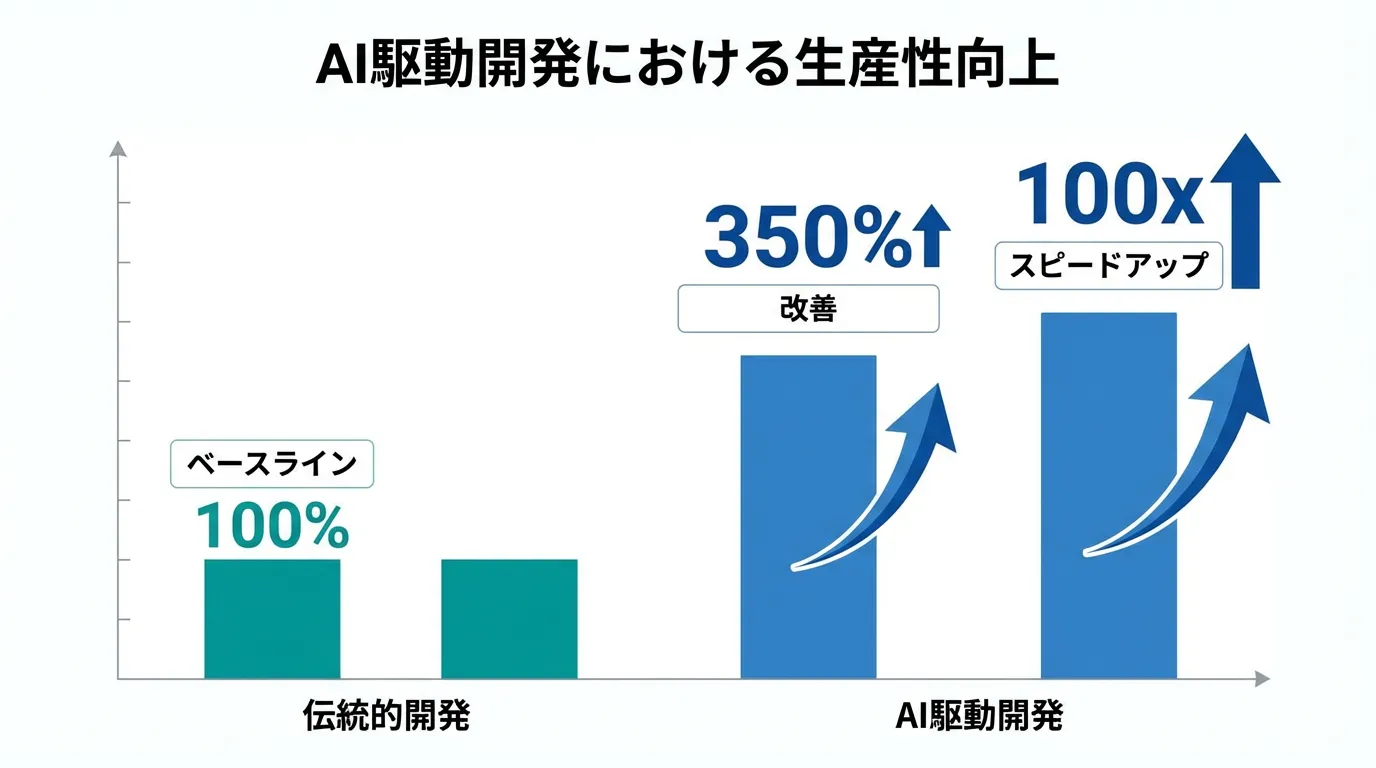

2026年、AI駆動開発は幻滅期を脱し、啓蒙期に突入しています。実際の成果も報告されています。

- SPONTOの事例:実プロジェクトで開発生産性が平均350%向上、コード記述時間が70%削減

- 富士通の事例:法改正対応などの定型保守作業を「3人月」→「4時間」に短縮(生産性100倍)

しかし、すべてのエンジニアが同じ恩恵を受けているわけではありません。Findyの調査では、ハイスキル層のプルリクエスト数は増加した一方、ジュニア層では減少が見られました。

この二極化を生む要因こそ、「AIをブラックボックスとして使うか、仕組みを理解して使いこなすか」の違いです。

2026年のトレンド: エージェント化されたSDLC

AI駆動開発は、単なるコード補完から「エージェント化されたSDLC(Software Development Life Cycle)」へと進化しています。

AIが複数の工程をまたいで仕事を取りに行く時代に、Transformerの仕組みを理解していることは、AI時代のエンジニアの基礎教養になりつつあります。

8. まとめ — 「使う」から「協働する」へ。AI Co-workの第一歩

Transformerの仕組み理解——単語埋め込み、アテンション機構、温度パラメーター——は、AIとの「対話品質」を上げる基盤です。

AIは「ブラックボックスのツール」から「協働する同僚」へと変わりつつあります。プロンプトを「指示」ではなく「対話」として設計し、AIとの協働品質を高める——これがAI時代のエンジニアに求められるスキルです。

AIを"使う"フェーズは終わりつつあります。これからは、AIと"協働"し、チーム全体の生産性を底上げする組織が競争優位を握ります。

Captain.AIは、AIエージェントをチームに組み込み、業務プロセスを自動化するプラットフォームです。Transformerの仕組みを学んだ今こそ、AI Co-workを実践する絶好のタイミング。

無料相談でご自身のチームに最適なAI活用法を見つけてください。

- カテゴリー

- タグ

- システム運用 (16)

- TypeScript (1)

- WebAssembly (2)

- ウォーターフォール開発 (2)

- 業務システム (28)

- CSS (2)

- GraphQL (1)

- プログラミング (31)

- スタートアップ (11)

- Nexaweb (1)

- BaaS (10)

- データベース (5)

- SPA (2)

- 基本用語 (26)

- Case study (5)

- Keyword (10)

- FaaS (1)

- システム開発 (69)

- スクラム (1)

- フロントエンド (38)

- AI (26)

- アジャイル開発 (18)

- Supabase (1)

- イノベーション (5)

- Database (2)

- 月額制 (1)

- PaaS (3)

- ACF (1)

- BookReview (3)

- サービス開発 (5)

- React (3)

- Firebase (1)

- クラウドサービス (12)

- low-code (2)

- バックエンド (8)

- ナレッジマネジメント (1)

- ChatGPT (1)

- Vue.js (2)

- Tailwind CSS (1)

- DBaas (2)

- プロジェクト管理 (13)

- セミナー (2)

- Web (21)

- 失敗事例 (2)

- Hexabase_health (1)

- 生成AI (7)

- 受託開発 (1)

- Kubernetes (3)

- WebComponents (1)

- 通知 (1)

- API (6)

- Next.js (1)

- フレームワーク (3)

- ローコード開発 (4)

- ノーコード開発 (1)

- JavaScript (2)

- Hexabase (12)

- LLM (3)

- 画像生成 (1)

- DX (34)