COLUMN

コラム

2026年04月13日

Gemma 4が示す未来。小規模組織が大市場を奪う「AI民主化2.0」の到来

2026年4月、AI活用における企業規模の壁が崩壊した。 Google Gemma 4のApache 2.0ライセンスでの公開は、オープンソースLLMがChatGPT初期と同等以上の性能で無償利用可能になったという歴史的転換点である。大企業の資本力ではなく、「いち早くAIを活用する組織」が市場を奪い取る時代が始まっている。

ChatGPTの衝撃、再び

2022年11月、ChatGPTが世界を驚かせた。誰でも自然言語でAIと対話できるという体験は、テクノロジーの民主化を象徴する出来事だった。

2026年4月、同じ驚きが再び起きている。しかし今回は、さらに革命的だ。オープンソースLLMが、ChatGPT初期レベルと同等以上の性能に到達したのである。しかも、完全無償、完全オフライン、完全カスタマイズ可能という形で。

この変化の象徴が、Googleが2026年4月2日に発表したGemma 4だ。そして、この発表が企業のAI活用における「ゲームチェンジ」となる理由は、モデルの性能そのものよりも、Apache 2.0ライセンスにある。

Gemma 4の衝撃 — 20倍モデルを超える31Bの実力

Google DeepMindの公式ページによると、Gemma 4は4つのサイズで提供される。

- Effective 2B (E2B)— エッジデバイス向け超軽量モデル

- Effective 4B (E4B)— モバイル・ローカル環境向け

- 26B Mixture of Experts (MoE)— 効率と性能のバランス

- 31B Dense— 最高品質、ファインチューニング向け

この中で最も注目すべきは31B Denseモデルだ。

Googleは公式ブログで、Gemma 4を「byte for byte, the most capable open models(バイト単位で最も高性能なオープンモデル)」と表現している。実際、31Bモデルは以下の驚異的な成果を達成した。

- 世界ランキング #3— Arena AI text leaderboardで、独自モデルを含む全LLMの中で3位

- AIME 2026で89.2%— 数学オリンピック級の問題で高得点

- 20倍モデルを超える性能— 620Bパラメータのモデルを上回る

- 256Kコンテキスト— 長文書類の処理が可能

しかし、真の革命は性能ではなくライセンスにある。

Apache 2.0ライセンスの革命的意義

従来のGemmaシリーズは独自ライセンス条項だったが、Gemma 4はApache 2.0ライセンスで公開された。これは以下を意味する。

- 無制限の商用利用— ライセンス料ゼロ、収益規模の制限なし

- 修正・再配布の自由— 自社業務に特化したカスタマイズが可能

- ベンダーロックイン回避— 特定クラウドベンダーへの依存なし

- エコシステム加速— オープンソースコミュニティが技術革新を加速

VentureBeatの分析では、「ライセンス変更がベンチマークより重要かもしれない」と指摘されている。Apache 2.0は、技術の民主化を超えた「ビジネスモデルの民主化」をもたらすのだ。

ローカルLLMの性能爆発 — ChatGPT初期レベルを無償で

Gemma 4は単独の現象ではない。2026年、オープンソースLLM全体が驚異的な性能向上を遂げている。

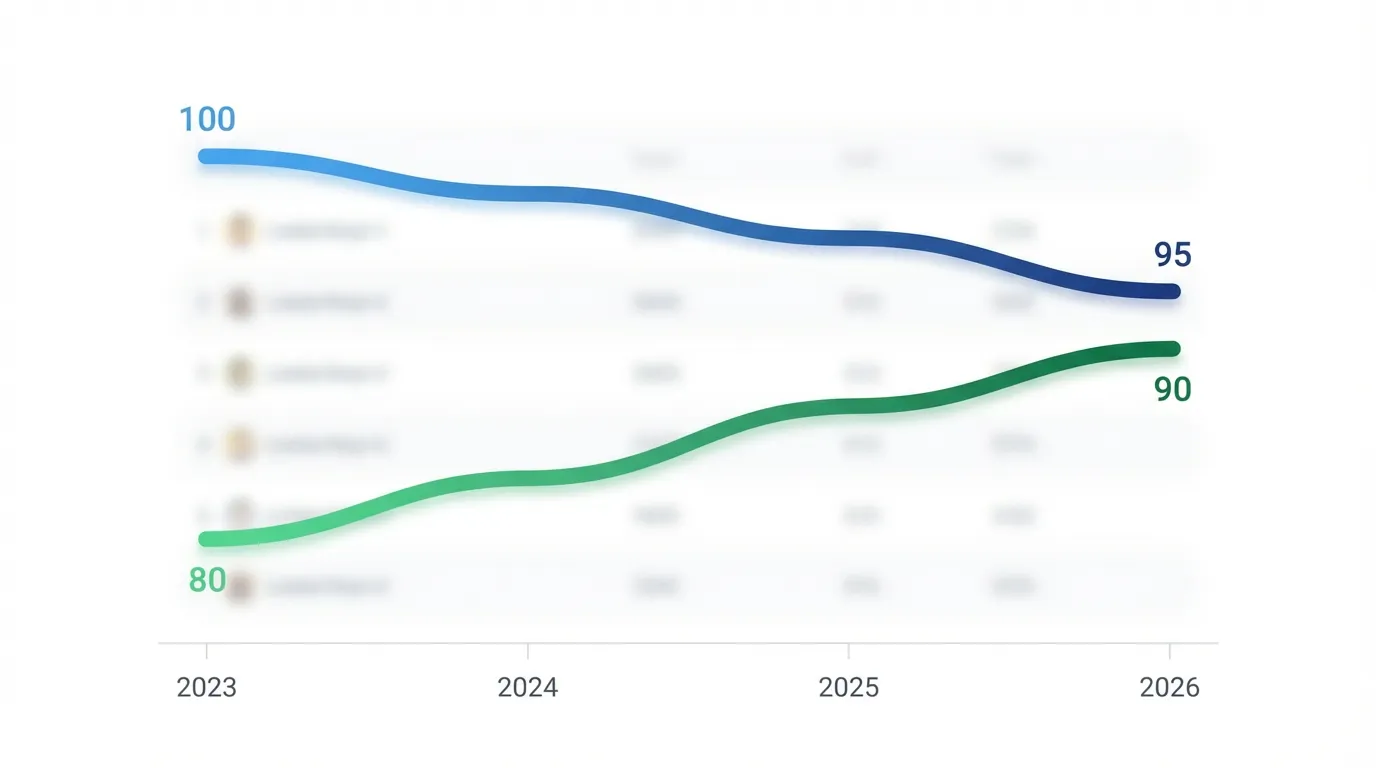

性能ギャップが5ポイントまで縮小

BentoMLの分析によると、オープンソースと独自LLMの性能ギャップは劇的に縮小している。

- 2023年: 20ポイント差

- 2026年: 5ポイント差

トップローカル14Bモデル(Qwen 2.5 14B、Phi-4、Gemma 3 12B)は、ChatGPT GPT-5.2の80〜90%の品質に到達している。日常タスク(コーディング、要約、メール作成、Q&A)では、ブラインドテストで区別不可能なレベルだ。

客観的ベンチマークが証明する性能

「個人の感想」ではなく、客観的なベンチマークがこの変化を裏付けている。

世界で最も信頼されているLMSYS Chatbot Arena(600万人以上の投票)では、オープンソースのGLM-5がElo 1451を記録し、GPT-4に迫る性能を示している。HuggingFace Open LLM Leaderboardでは、数十のオープンソースモデルがChatGPT初期レベルを超える性能を達成している。

Artificial Analysisでは、100以上のモデルが品質・価格・速度で比較されており、以下のような具体的な成果が示されている。

- コーディング: Qwen 2.5 Coder 14BがHumanEval 85%(vs Llama 3.3 8B 68%)で、GPT-4oをコードベンチマークで上回る

- 数学: GLM-4.7がAIME 2025で95.7%(Gemini 2.0 Pro Thinkingと同等)

- 総合: DeepSeek V3.2がGPT-5を数学で上回り、GPT-5.4の90%の性能を1/50の価格で提供

日本も例外ではない

国立情報学研究所が公開したLLM-jp-4は、日本語MT-BenchでGPT-4oやQwen3-8Bを上回る性能を達成した。約12兆トークンの良質なコーパスで学習した8Bモデルと32B-A3B MoEモデルが、オープンソースライセンスで一般公開されている。

「無料だから性能が低い」という常識は、完全に崩壊したのだ。

企業ごとのクローズドLLM環境が標準に

性能とライセンスの両面で条件が整ったことで、企業のAI活用に大きな変化が起きている。それが「企業ごとのクローズドLLM環境の標準化」だ。

エンタープライズ向けトップモデルが出揃った

2026年、エンタープライズ向けオープンソースLLMのトップ3が明確になった。

- DeepSeek-V3(671B MoE) — GPT-4.5超えの数学・コーディング性能

- Qwen 3.5(397B MoE) — 201言語対応、統合ビジョン-言語機能

- GLM-4.5— ツール使用・開発ワークフロー最適化

VentureBeatの調査では、78%の技術リーダーがオープンソースLLMを優先している(ベンダーロックイン回避、カスタマイズのため)。41%が今後オープンソースモデルの使用を増やすと回答している。

ローカルLLMの3つのメリット

なぜ企業はローカルLLMに移行するのか?主な理由は3つだ。

1. プライバシーとデータ主権

ローカル環境で完全に動作するため、データが外部に出ない。金融、医療、官公庁など、機密性の高い業務でも安心して使用できる。プライベート医療プロバイダーは、Mistral 7Bで臨床メモ要約・診察後サマリー生成を実現している(Hugging Face Transformers + QLoRA、ハイブリッド構成)。

2. コスト削減

APIコール料金がゼロになる。ChatGPT-4は入力$10/百万トークン、出力$30/百万トークンだが、Llama-3-70-Bは入力$0.60/百万トークン、出力$0.70/百万トークンで、約10倍安い(性能差はわずか)。月間API料金が100万円だった企業が、ローカルLLM移行でゼロ円になった事例もある。

3. カスタマイズの自由

自社業務に特化したファインチューニングが可能。オープンソースライセンスにより、モデルの重み自体にライセンス料が不要で、AIロードマップを完全に制御できる。

インフラ要件は下がり続けている

「ローカルLLMは高額なインフラが必要」という懸念も、急速に解消されつつある。AI効率化により、2026年には高品質AIモデルがわずか20ワット(人間の脳と同等)で動作する。NVIDIA A100/H200/B200、AMD MI300X/MI350X等のGPUが一般化し、3年前は数ヶ月かかった実装が、今は数日〜数週間で可能になっている。

小規模組織の逆転可能性 — 速度が資本を超える時代

ローカルLLMの台頭が最も劇的な影響を与えるのは、企業規模による競争力の逆転だ。

18〜24ヶ月以内に10人企業がFortune 500と同等に

PwCの予測では、18〜24ヶ月以内に、10人のビジネスがFortune 500企業と同等のAI能力を獲得するとされている。AI消費電力が最大100倍削減されながら精度は向上し、高額なクラウドコンピューティング費用なしで、ローカルデバイスで高度なAIをデプロイ可能になるためだ。

中小企業のAI導入率も急増している。2023年36% → 2024年42% → 2025年57%と、2年で58%増加(Business.com調査)。中小企業は大企業より機敏で、小チームがAIを迅速に実装し、即座に生産性向上を実感できる。

一方、日本では中小企業5% vs 大企業30%超という15倍の導入ギャップがあるが、これは「逆転のチャンス」でもある。コスト障壁が崩壊した今、いち早く動いた組織が優位に立つ。

スタートアップの4つの優位性

なぜ小規模組織が大企業を逆転できるのか?主な理由は4つだ。

1. 運用速度

スタートアップは官僚主義が少なく、AIソリューションのテスト・実装が高速。大企業は承認プロセス・複雑な階層で遅延する。Harvard Business Reviewは、「小チームがAIで大手と競争し、outsized impactを達成」していると報告している。

2. コスト効率

少人数・少予算で、エンタープライズレベルの機能・サービスをローンチ可能。使用量ベース価格により、エンタープライズ最低契約額が消失した。

3. カスタマイズ性

小回りの利く組織が、業務特化型AIを素早く構築できる。大企業は既存システムとの統合に時間がかかる。

4. 組織的準備

Talisman AIの分析では、こう警告されている。

「AI予算をmoat(堀)として使う大企業には悪いニュース。コスト障壁が崩壊したら、実行速度と組織的準備だけが唯一の競争差別化要因になる。」

実際に起きている「逆転」の事例

すでに、小規模組織が大企業を脅かす事例が続出している。

- Vanta(コンプライアンス自動化)— 5年前には存在しなかったカテゴリで、$150M調達、$4.15B評価額。12,000以上の組織にサービス提供

- Drata— パンデミック中にローンチし、最初の45日で100顧客獲得

- Deepgram(音声AI)— Google、Microsoft Azure、AWSに挑戦。ノイズの多い音声でも高精度を実現

- サカナAI(日本)— 創業1年で評価額1800億円、国内最速ユニコーン

- PKSHA Technology(日本)— 対話AI国内シェアNo.1、メガバンク・自治体が導入

これらのスタートアップは、大企業の「ビジネスモデルが現代企業のニーズと根本的に不一致」という弱点を突いて成長している。

未来予測: 2026-2028年のAI活用シナリオ

ローカルLLMの台頭は、今後2〜3年で企業のAI活用をどう変えるのか?

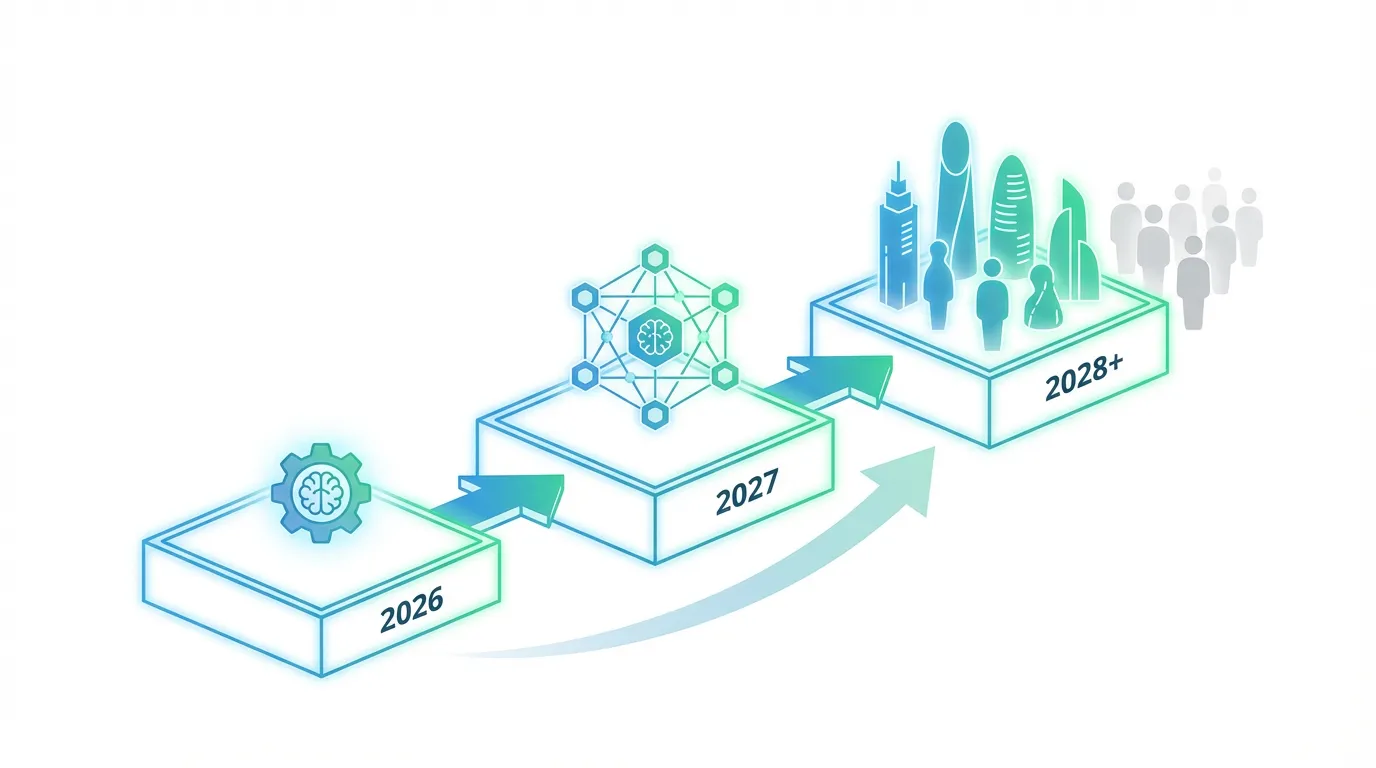

2026年後半 — 業務特化型モデルの実用化

Gemma 4クラスのモデルが業務特化型にファインチューニングされ、各業界で実用化が進む。「中小企業向けローカルLLMインフラ構築サービス」が急成長し、導入障壁がさらに下がる。

2027年 — クローズドLLM環境の標準化

企業ごとのクローズドLLM環境が標準化され、「オンプレミスAI」が再び注目される。「AIカスタマイズエンジニア」が新職種として確立され、小規模スタートアップが大企業のシェアを奪う事例が続出する。

2028年以降 — AI非活用企業の淘汰

オープンソースLLMエコシステムが完全に成熟し、世界中の企業がAIを活用するようになる。この時点で、「AIを活用しない企業」は市場から淘汰される可能性が高い。

Foundation Capitalの分析によると、「2025-2026年はAI-nativeスタートアップによる破壊の年」であり、2028年にはその影響が全業界に波及する。

ローカルLLM時代の業務自動化プラットフォーム

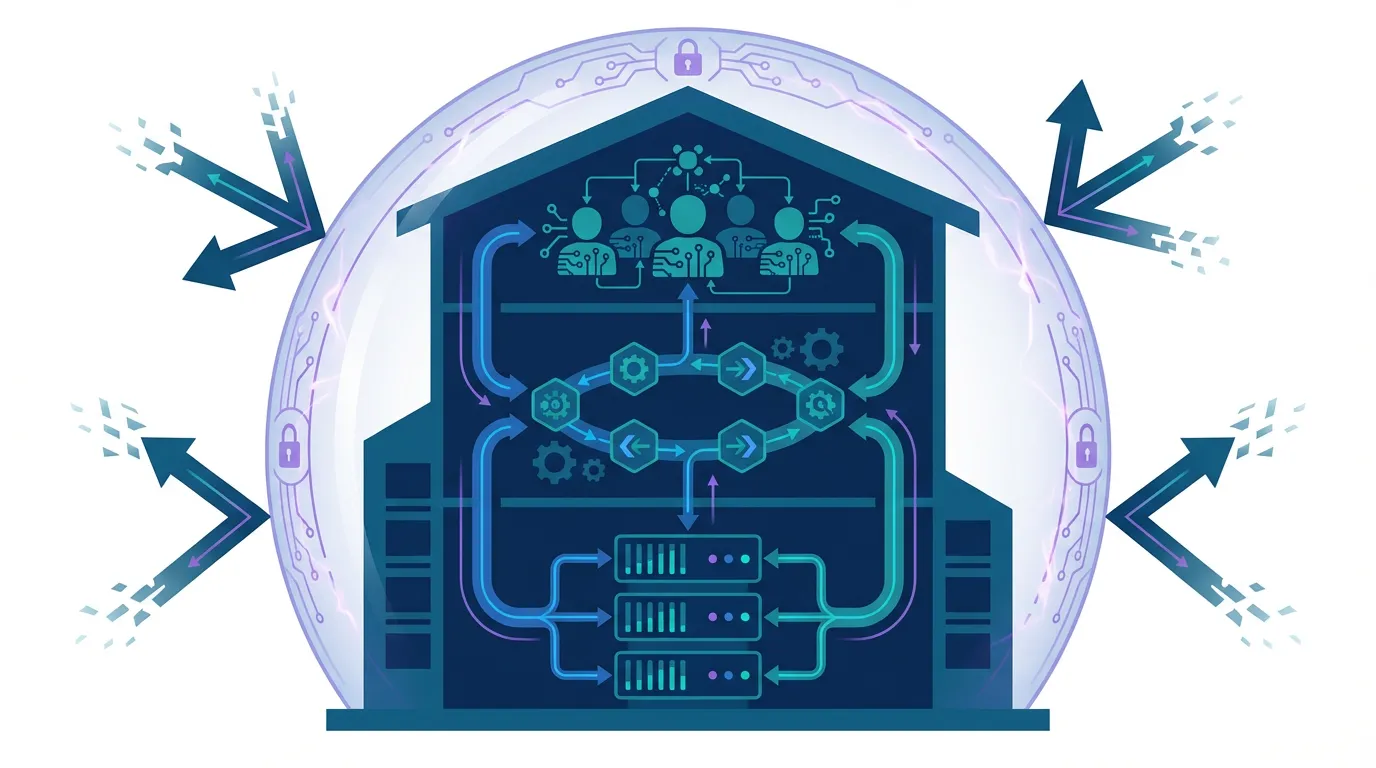

ローカルLLMを導入したいが、統合・運用が複雑という課題がある。この課題を解決するのが、Captain.AIだ。

Captain.AIは、複数のローカルLLMを統合管理する業務自動化プラットフォームである。Gemma 4、DeepSeek-V3、Qwen 3.5等のオープンソースLLMを統合し、企業の業務フローに最適化されたAIエージェントを構築できる。

さらに、Kuboを使えば、PrivateなLLMをKubernetes環境で安全に運用できる。KuboはKubernetes as a Service(コンテナ運用基盤)であり、オンプレミス環境でもGemma 4等のローカルLLMを動作させることが可能だ。Captain.AIとKuboを組み合わせることで、完全にクローズドなAI環境を構築し、データ主権を守りながら高度な業務自動化を実現できる。

ローカルLLM時代の業務自動化を、Captain.AIで実現しませんか?

まとめ — 2026年、AI活用における勝者は資本ではなく速度で決まる

2026年4月、Google Gemma 4のApache 2.0ライセンスでの公開は、「AI民主化2.0」の象徴的な出来事だった。

オープンソースLLMがChatGPT初期レベルに到達し、企業規模の壁が崩壊した。18〜24ヶ月以内に、10人のビジネスがFortune 500企業と同等のAI能力を獲得する。

この変化の中で勝者となるのは、資本力を持つ大企業ではない。いち早くローカルLLMを活用する組織だ。

Talisman AIが警告したように、「コスト障壁が崩壊したら、実行速度と組織的準備だけが唯一の競争差別化要因」になる。今すぐ動き始めた組織が、2028年の勝者になる。

2026年、AI活用における勝者は、資本ではなく速度で決まる。

- 『Proxmox + K3s なら無料で始められる』の罠。セルフホスト Kubernetes に潜む年間 2,000 万円の隠れコスト

- CLAUDE.mdはもう古い?ハーネスエンジニアリング5構成要素で実現する、AIが勝手に学習する開発環境

- AI駆動開発時代のシステム内製化 — なぜ成功する企業と失敗する企業があるのか? 5つの失敗パターンと3つの成功ステップ

- 『Dockerだけでは足りない。』2026年、AI駆動開発基盤に必要な Docker × Kubernetes × 自動化の全体設計

- 「50人→10人、6ヶ月→2週間。」AI駆動開発がシステム開発企業の3大構造課題を同時に解決